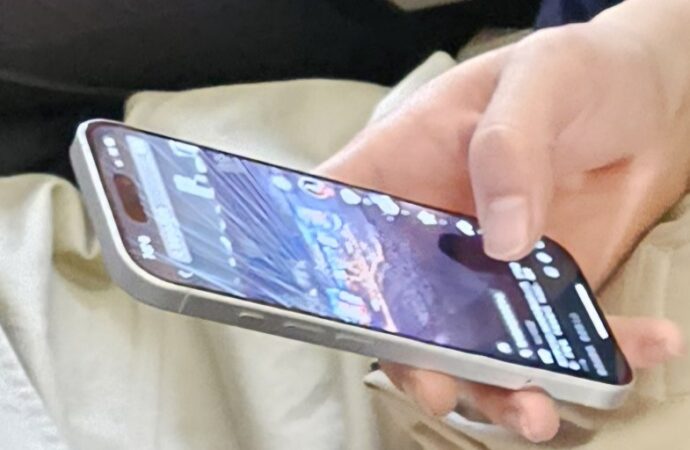

K metro 0 – Roma – C’è una frase pronunciata dall’avvocato dell’accusa durante il processo di Los Angeles che vale come sintesi di un’epoca. “Come si fa a far sì che un bambino non posi mai il telefono? Si chiama ingegneria della dipendenza”, ha detto il legale davanti alla giuria californiana. Era il 25 marzo del 2026.

K metro 0 – Roma – C’è una frase pronunciata dall’avvocato dell’accusa durante il processo di Los Angeles che vale come sintesi di un’epoca. “Come si fa a far sì che un bambino non posi mai il telefono? Si chiama ingegneria della dipendenza”, ha detto il legale davanti alla giuria californiana. Era il 25 marzo del 2026. Quella giuria ha risposto condannando Meta e Google al pagamento di diversi milioni di dollari di danni a favore di una ragazza che aveva iniziato ad usare Youtube a sei anni e Instagram a nove, finendo nel ruolo di vittima.

La giuria ha concluso che le app di Meta – instagram- e Youtube di Google erano state deliberatamente costruite per creare dipendenza, e che i vertici delle aziende ne fossero consapevoli. Ma nessuna misura era stata adottata per proteggere gli utenti più giovani.

Quella di Los Angeles non è una sentenza qualunque. Potrebbe aprire la strada a migliaia di cause analoghe e costringere la Silicon Valley a ripensare le funzionalità che tengono i fruitori incollati allo scroll infinito. I commentatori americani evocano già il paragone più temuto dalle grandi corporation: il confronto con le cause degli anni 90 contro Big Tobacco, che costrinsero l’industria del tabacco a smettere di prendere di mira i minori con la pubblicità.

La novità giuridica del caso californiano è proprio questa: il bersaglio legale si è spostato. Nel mirino non ci sono i contenuti che circolano sulle piattaforme, ma il modo in cui i servizi di social media sono stati progettati. E’ la stessa intuizione che, a pochi giorni dalla sentenza ha ispirato in Italia, il disegno di legge presentato dai senatori del Partito Democratico, Antonio Nicita e Lorenzo Basso. Il testo muove da un presupposto preciso: il danno maggiore che le grandi piattaforme infliggono agli utenti non riguarda ciò che pubblicano, ma il modo in cui lo pubblicano. Dunque, niente censura, niente moderazione dei contenuti. L’obiettivo è la struttura stessa, l’architettura della macchina. Il cuore del provvedimento individua tre pratiche algoritmiche da vietare. La prima è la dipendenza: scroll infinito, autoplay e notifiche studiate per stimolare il sistema nervoso. La seconda è l’influenza algoritmica: le piattaforme costruiscono preferenze profili comportamentali senza una esplicita scelta dell’utente. La terza, la più controversa, è la manipolazione algoritmica selettiva- la promozione intenzionale di alcuni contenuti a scapito di altri, una pratica che, secondo il ddl va vietata per tutelare informazione e democrazia.

La proposta introduce un cambio radicale: non basta il silenzio, serve l’assenso attivo. L’utente deve poter scegliere in modo autonomo il grado di profilazione accettato, incluso il diritto a non essere profilato. Per i minorenni, queste protezioni scattano per default . Le sanzioni si muovono in un range dal 2 al 4 per cento del fatturato, con un massimo di 20/30 milioni. Le risorse andrebbero a finanziare un Fondo per l’alfabetizzazione digitale, destinato a programmi scolastici e campagne di sensibilizzazione.

Il DDL Nicita-Basso non nasce nel vuoto. Si inserisce in una stagione regolatoria senza precedenti, in cui i governi di ogni latitudine stanno cercando- con strumenti diversi e risultati alterni- di riprendere il controllo su ecosistemi digitali che per un ventennio hanno operato in sostanziale assenza di regole.

Tra il 2025 e i primi mesi del 2026 il mondo è stato attraversato da una serie di provvedimenti volti a ” governare” il mondo web. L’ Australia per prima ha introdotto il divieto più severo, vietando i social media ai minori di 16 anni. L’unione Europea ha inasprito le linee guida del digital services act in materia di minori. La Francia ha reso obbligatoria la verifica dell’età. Ma proprio l’esempio australiano dimostra che vietare l’accesso non elimina il danno: nella Repubblica dei canguri a distanza di mesi dall’entrata in vigore della disposizione sette ragazzi su dieci sono ancora presenti sui social, aggirando il divieto.

Ciò che distingue il DDL italiano dall’approccio del semplice divieto è la scelta di agire sulla responsabilità strutturale delle piattaforme, non sull’esclusione degli utenti. Nelle parole degli stessi senatori: “Le piattaforme digitali e i sistemi di intelligenza artificiale non sono più semplici strumenti. Sono ambienti che orientano comportamenti, relazioni, consumi, formazione e accesso alle informazioni. Per questo servono regole chiare, efficaci e aggiornate, che mettano al centro la persona e non il tempo di permanenza o la massimizzazione dell’engagement”.

E’ una posizione che non ignora il quadro europeo: il provvedimento risulta pienamente compatibile con il diritto dell’Unione. Il DSA esenta le piattaforme dalla responsabilità per i contenuti di terzi, ma non armonizza gli standard sul design algoritmico, come previsto dal disegno di legge dei senatori del PD.

La domanda che resta aperta è se una legge nazionale possa far leva sufficiente su piattaforme che operano a livello planetario. E che probabilmente solo sistemi giuridici capaci di coordinarsi riusciranno a sottoporre a governo reale. Ma forse il coordinamento è già cominciato.